표정 트래킹

웹캠・iPhone을 사용한 페이스 트래킹

Motion Capture for VRC Avatar Viewer (이하 「캡처 앱」) 은 눈 깜빡임이나 입의 움직임 등의 표정도 아바타에 반영할 수 있습니다. 표정 데이터의 취득 방법과 아바타로의 송신 형식을 각각 선택하여 사용합니다.

2가지 데이터 소스 (취득 방법)

- 웹캠 (기본값) PC에 연결한 웹캠의 영상에서 표정을 추정합니다. 추가 장비가 필요 없어 누구나 사용할 수 있지만, 볼이나 혀의 움직임은 취득할 수 없는 등의 제약이 있습니다.

- iPhone (iFacialMocap) Face ID 지원 iPhone과 iFacialMocap (유료 iOS 앱) 을 사용하면 ARKit 기반의 52종류 고정밀 표정 데이터를 취득할 수 있습니다. 웹캠을 크게 능가하는 표현력입니다.

취득한 표정 데이터를 어떤 형식으로 아바타에 보낼지는 「표정 송신 형식」에서 선택합니다 (자세한 내용은 Step 3).

- iFacialMocap이 연결 중인 경우, 웹캠보다 iFacialMocap의 표정 데이터가 우선됩니다 (몸의 움직임은 웹캠 그대로)

- 송신 형식과 관계없이 iFacialMocap이 활성화되어 있으면 그쪽의 표정 데이터가 사용됩니다

- VRChat 연동의 자세한 내용은 VRChat에서 페이스 트래킹 가이드를 참조하세요

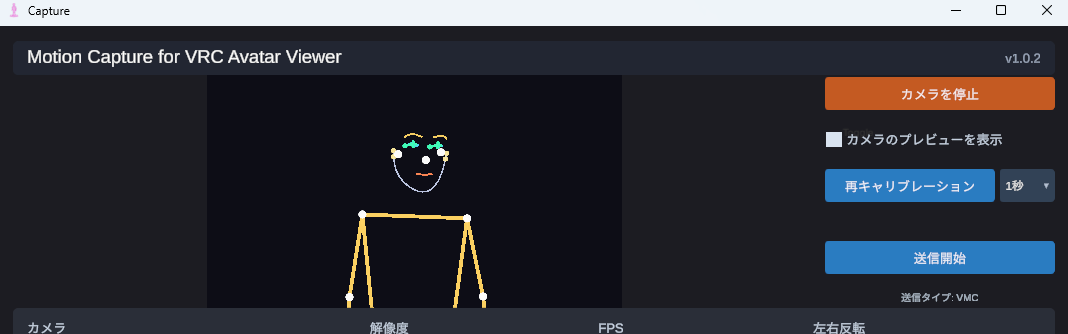

웹캠으로 표정을 취득하기

기본 방법입니다. 스트리밍 모드 가이드의 절차로 카메라를 시작하면 자동으로 웹캠에서 표정도 추정됩니다. 추가 설정은 필요하지 않습니다.

1-1. 취득할 수 있는 표정

- 눈 깜빡임 (양쪽 눈 각각)

- 모음 (아·이·우·에·오)

- 시선 (상하좌우)

- 눈썹의 상하, 입의 개폐, 입꼬리의 움직임 등

1-2. 취득할 수 없거나 / 약한 것

- 볼의 부풀림, 혀의 움직임

- 어두운 곳에서는 정확도가 크게 떨어집니다. 얼굴이 또렷하게 보이는 밝기가 필요

- 옆얼굴·고개 숙임 등 얼굴 정면이 보이지 않는 각도

- 웹캠 단독으로 사용하는 경우 권장은 VRM 표준입니다. 대부분의 아바타에서 자연스럽게 움직입니다

- Perfect Sync나 VRCFT도 동작합니다. 그러나 위와 같이 취득할 수 없는 움직임이 있습니다.

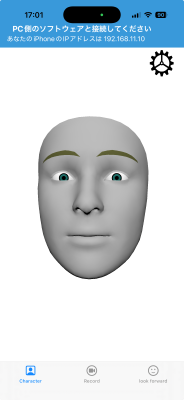

iPhone으로 고정밀 표정을 취득 (iFacialMocap)

Face ID 지원 iPhone (iPhone X 이후) 을 사용하면 웹캠보다 대폭 표정의 정확도를 높일 수 있습니다. iFacialMocap이라는 iOS 앱이 필요합니다.

2-1. 필요한 것

- Face ID 지원 iPhone 또는 iPad Pro

- App Store에서 구매한 iFacialMocap (iOS 유료 앱)

- iPhone과 PC가 같은 Wi-Fi (LAN)에 연결되어 있을 것

2-2. iPhone 측 설정

- iPhone에서 iFacialMocap을 실행합니다

- 화면에 「PC 측 소프트웨어와 연결해주세요」라고 표시되므로 IP 주소 (예:

192.168.1.10) 를 메모합니다

- iFacialMocap의 설정을 열고 「대상 설정」을 확인해주세요. 「대상 IP 주소」에 값이 들어 있으면 표시되지 않습니다. 그 아래에 있는 「대상 설정 초기화」를 누르고 앱을 재시작하면 표시됩니다.

2-3. 캡처 앱 측 설정

- 캡처 앱의 「iFacialMocap의 IP 주소」 칸에 메모한 iPhone의 IP를 입력

- 「iFacialMocap 사용」을 ON으로 설정

- 옆의 상태가 「수신 중」이 되면 연결 성공

2-4. 상태 표시의 의미

| 상태 | 의미 |

|---|---|

| 정지 중 | 「iFacialMocap 사용」 토글이 OFF |

| IP 미입력 | iPhone의 IP가 비어있음. 입력하면 자동으로 연결을 시도합니다 |

| 연결 대기 중 | 핸드셰이크는 송신했지만 iPhone에서 응답이 없음 (iFacialMocap이 실행되지 않음 / IP 다름 / 다른 네트워크 등) |

| 수신 중 | 정상적으로 표정 데이터를 수신하고 있습니다 |

2-5. 취득할 수 있는 표정

ARKit 기반의 52종류 블렌드 셰이프 + 머리 회전 + 좌우 시선을 취득할 수 있습니다. 웹캠으로 취득할 수 없는 볼의 부풀림이나 혀도 포함됩니다 (아바타 측이 해당 블렌드 셰이프를 가지고 있어야 합니다).

- iFacialMocap을 활성화하고 있는 동안에도 몸·팔·손가락의 움직임은 웹캠에서 계속 취득됩니다

- 「표정만 iFacialMocap, 몸은 웹캠」이라는 하이브리드 구성입니다

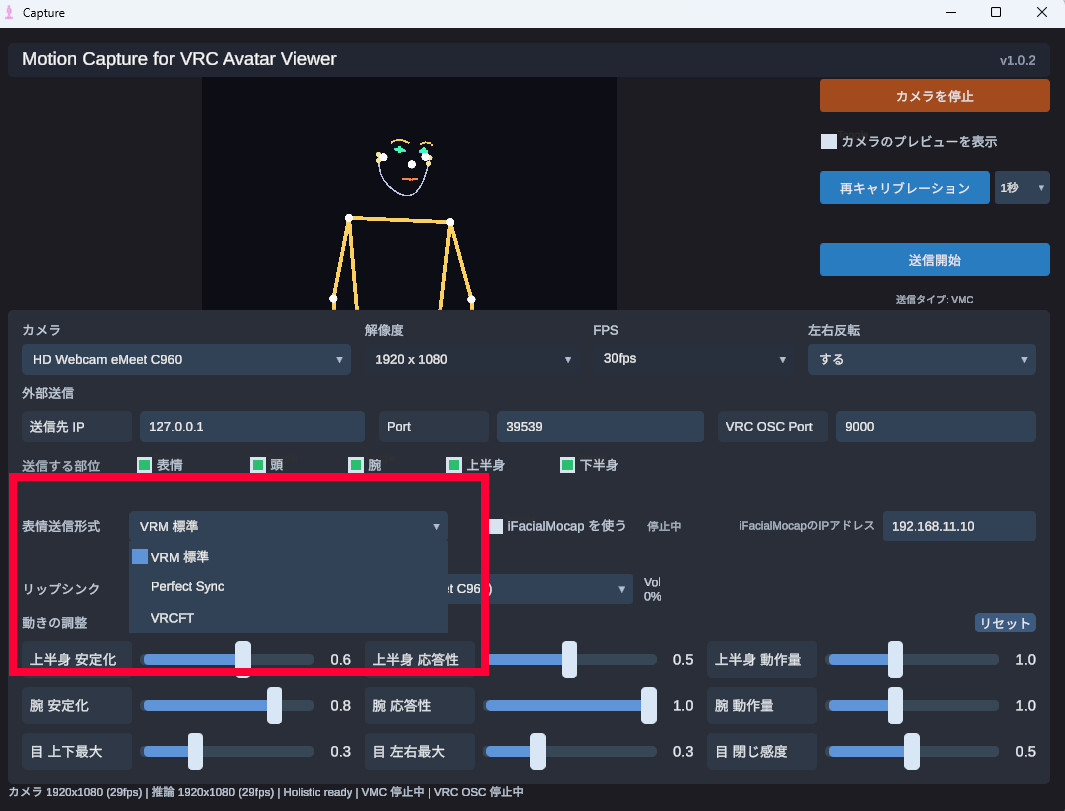

표정 송신 형식 (블렌드 셰이프 규격) 선택

캡처 앱의 「표정 송신 형식」 드롭다운에서 선택합니다. 아바타 측의 대응 상황에 맞춰 선택해주세요.

VRM 표준

VRM이 원래 가지고 있는 눈 깜빡임·모음·시선 등의 기본 표정을 VMC로 송신합니다. 어떤 아바타에서도 동작하지만 표현은 단순합니다. 웹캠 단독으로 사용하는 경우 기본 권장입니다.

Perfect Sync

ARKit의 52종류 블렌드 셰이프를 VMC로 송신합니다. Perfect Sync 대응 아바타에서는 입꼬리·눈썹·눈꺼풀의 섬세한 움직임까지 반영됩니다. iFacialMocap과 조합하면 효과적입니다.

VRCFT

VRCFaceTracking 5.x의 Unified Expressions 규격으로, VMC와 VRChat OSC 양쪽에 동시 송신됩니다. VRChat 내의 아바타와 뷰어 (OBS 스트리밍용 등) 양쪽에서 동일한 표정을 재현할 수 있는 점이 특징입니다.

- VRCFT를 선택하면 「송신 시작」 버튼 아래의 캡션이 「송신 타입: VMC + VRChat OSC」가 됩니다

- VRChat 연동의 자세한 절차는 VRChat에서 페이스 트래킹 가이드를 참조하세요

- 캡처 앱 측의 「표정 송신 형식」과 Viewer 측의 「타입」은 동일한 것을 선택해야 합니다 (자세한 내용은 Step 4)

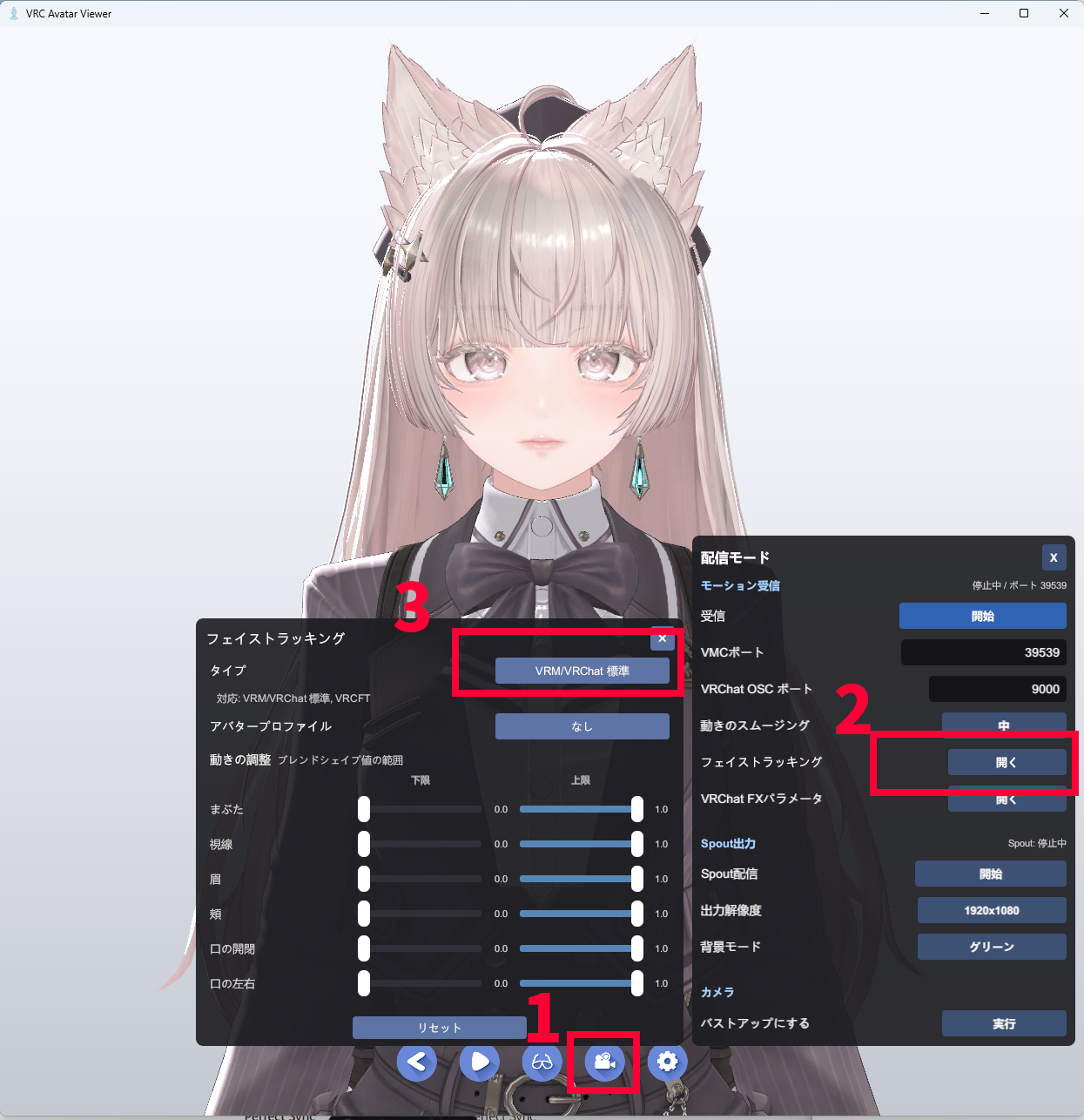

Viewer 앱 측에서 페이스 트래킹 타입 선택

캡처 앱 측에서 선택한 「표정 송신 형식」과 Viewer 앱 측에서 선택하는 「타입」은 동일한 것을 선택해야 합니다. Viewer 측 타입은 스트리밍 모드 툴바 → 「페이스 트래킹」 버튼으로 열리는 창에서 전환합니다.

4-1. 창 열기

- Viewer 앱에서 아바타를 표시합니다

- 스트리밍 모드 (Streaming) 를 ON으로 설정

- 스트리밍 패널 내의 「페이스 트래킹」 버튼을 클릭

4-2. 타입 전환

창 상단의 「타입」 버튼을 클릭할 때마다 VRM/VRChat 표준 → Perfect Sync → VRCFT 순으로 전환됩니다. 캡처 앱 측의 선택과 일치시켜주세요.

| Viewer 측 「타입」 | 캡처 앱 측 「표정 송신 형식」 |

|---|---|

| VRM/VRChat 표준 | VRM 표준 |

| Perfect Sync | Perfect Sync |

| VRCFT | VRCFT |

4-3. 「대응:」 표시 보는 법

「타입」 버튼 바로 아래에 현재 로드 중인 아바타가 대응하고 있는 타입의 목록이 「대응: VRM/VRChat 표준, Perfect Sync」와 같이 표시됩니다.

4-4. 주의 사항

- VRCFT 선택 중에는 카테고리별 표정 강도 슬라이더가 비활성화됩니다: VRCFT는 VRChat OSC를 통해 표정 파라미터를 직접 구동하므로 Viewer 측의 블렌드 셰이프 강도 조정은 적용되지 않습니다